Es gibt Webmaster, die haben die Anmeldeseite für URL noch nie gesehen oder schon vergessen wie die Seite aussieht. Das ist gut so. Die Notwendigkeit, Seiten anzumelden, erstreckt sich eher auf Ausnahmefälle. Der vermeintliche Nutzen des Anmeldeformulars lockt Spammer an, welche automatisiert ihre URL im Sekundentakt einspeisen. Eine angemeldete URL bedeutet jedoch keineswegs zwangsläufig, dass die URL in den Index gelangt.

Bisher war das ziemlich einfach eine URL zu übermitteln. Die URL einer neuen oder geänderte Webseite wurde in das Formular kopiert. Oder die URL einer Seite, die entfernt wurde und möglichst etwas schneller aus dem Index verschwinden sollte. Mit etwas Glück konnte man am nächsten Tag, oder einige Tage später, das Ergebnis sehen. Manchmal gab es kein Ergebnis.

URL anmelden – Die wichtigsten Änderungen

- Max. 50 URL pro Woche

- 10 URL einschliesslich verlinkter URL pro Woche

- Seite anmelden heisst nun Crawl URL

- Anmeldung über Google Webmaster Tools möglich

Die Namensänderung auf Crawl-URL wird in den Google Webmaster Tools verständlich. Dort sehen Sie unter dem Punkt Diagnose – Abruf wie durch Googlebot, dass der Aufnahme in den Google-Index ein Crawl-Vorgang vorausgeht. Im Volksmund wird die Übergabe einer URL häufig als Anmeldung bezeichnet. Anmeldung wird jedoch sehr häufig mit Aufnahme gleichgestellt.

Tatsächlich wird Google nur die inhaltliche Änderung der übergebenen URL mitgeteilt. In Folge erhalten die GoogleBots den Auftrag, die Änderungen zu erfassen. Ob die erfassten Inhalte tatsächlich in den Index gelangen wird anschliessend festgelegt. So kann es passieren, dass Google Crawler eine Seite besuchen, die Inhalte dennoch nicht in den Index gelangen.

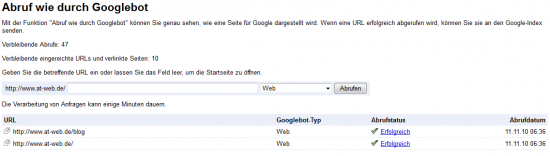

Abruf wie durch Googlebot

Die neue Funktion in den Google Webmaster Tools, Abruf wie durch Googlebot, startet mit der Anzeige der verbleibenden Crawlvorgänge. Bereits durchgeführte Crawls werden aufgelistet.

Beim Aufruf der Funktion stehen in meinem Test statt der versprochenen 50 nur 47 mögliche Abrufe im Zähler. Dem gegenüber sind zwei URL gelistet, die abgerufen wurden. Das Abrufdatum liegt mit dem 11.November 2010 schon einige Monate zurück. Also 50 Abrufe pro Woche? Oder pro Jahr? 😉

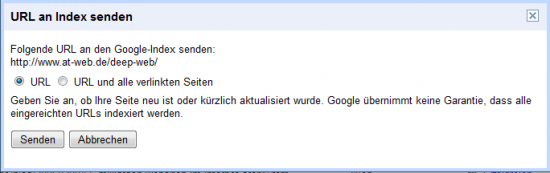

Nein, durch einen aktuellen Abruf werden die Zahlen auf 50 bzw. 10 mit verlinkten Seiten gesetzt. Für die aktuell abgerufene Seite erscheint ein Link, an Index senden.

Wird der Link “Erfolgreich” in der Spalte Abrufstatus geklickt, Eröffnen sich Angaben, die an die GoogleBots übermittelt werden. Im Wesentlichen sind das die vom Server übermittelten Header-Angaben und der Quelltext der Seite. Zu sehen sind zusätzlich URL, Datum, Googlebot-Typ (Web) und Downloadzeit. Erstaunlich, unter Downloadzeit (in Millisekunden) ist keine Angabe zu finden. Immerhin legt Google sehr viel Wert auf schnelladende Seiten. Oder wurde die Seite so schnell geladen, dass die Ladezeit nicht messbar ist? 😉

Für das Crawling sollen nur URL vom Typ Web übermittelt werden. Bilder oder Videos sollen über die enstsprechenden Sitemap Typen eingereicht werden.

Wann sollten URL vorgeschlagen werden

Beispielsweise ist ein Betreiber einer Website gleichzeitig Organisator einer Veranstaltung. Vielleicht der Kanu-Verleih, der eine Kanu-Wochenendfahrt organisert hat. Weil es nun plötzlich schneit, oder andere völlig ungeplante Ereignisse eintreten, werden am Donnerstag noch Hinweise veröffentlicht, die vor dem Wochenende die Teilnehmer erreichen soll.

Abgesehen von anderen Möglichkeiten die Teilnehmer zu erreichen, bietet sich an, die Webseite schnell im Google-Index aktualisieren zu lassen. Eine News-Website wird damit keine Probleme haben, weil sie häufig von den Googlebots besucht wird. Ebenso Seiten von Webblogs, die per Ping über Veröffentlichung oder Änderung die Suchdienste informieren.

Websites, die nicht so häufig von Crawlern besucht werden, weil sich die Inhalte eher selten ändern, würden vergeblich auf schnelle Neuindexierung warten. Genau dafür bietet sich die Methode Abrufen wie durch Googlebot an. Nach dem erfolgreichen Besuch des Googlebots, der innerhalb einiger Sekunden erledigt ist, kann die Seite an den Google-Index übermittelt werden.

Wann Crawling öffentlich übermitteln

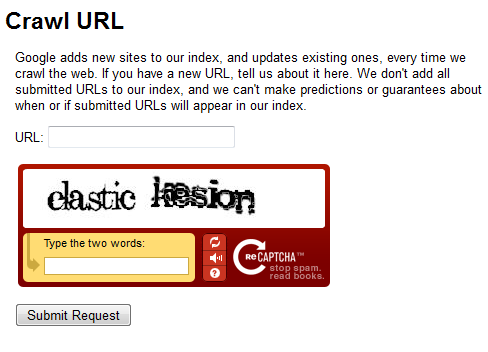

Über die Google Webmaster Tools gibt es Informationen ausschliesslich für Websites, auf die der Webmaster Zugriff hat. Die Übermittlung von URL gelingt ebenso nur für Webseiten aus dem Webmaster Tools Portfolio. Änderungen für andere Webseiten können nur über das öffentliche Crawl-URL Formular übermittelt werden.

Es ist naheliegend, dass die Anmeldungen über die Google-Webmaster Tools einen grösseren Vertrauensbonus bekommen als das öffentliche Formular. Loggt sich der Webmaster erst mit seinem Account ein und benutzt anschliessend das öffentliche Formular, sollte ein vergleichbarer Vertrauensbonus vergeben werden, da nicht anonym URL übermittelt werden.

Vorschau für Seiten

Ebenfalls in den Google Webmaster Tools, unter dem Punkt Google Labs, gibt es die Funktion Vorschau. Drei unterschiedliche Ansichten der ausgewählten Seite zeigen, wie fit die Seite für die Vorschaufunktion in den Ergebnislisten von Google ist. Sie erinnern sich? Mit Instant Preview wird durch überfahren des Treffers mit dem Mauszeiger eine Vorschau der Seiten angezeigt. Google kennt folgende Formen der Vorschau, die separat dargestellt werden:

- On-Demand Desktop Search Instant Preview

- Pre-render Desktop Search Instant Preview

- Mobile Search Instant Preview

Im optimalsten Fall sehen alle drei Ansichten gleich aus. Unterschiede können enstehen, weil Grafiken, JavaScripts und/oder andere Seitenelemente vom Crawling ausgeschlossen sind.

Anhand der Startseite von at-web.de stellte ich fest, die On-Demand Desktop Search Instant Preview ist dem Original scheinbar indentisch. Die Pre-render Desktop Search Instant Preview verzichtet auf einige Grafiken und Vorschaubilder für Beiträge. Es wurden 42 Fehler aufgezählt, die alle in zwei Ursachen münden. Der erste Fehler ist selbsterklärend: Durch eine robots.txt Datei blockiert. Die zweite Ursache Abruffehler ist nicht nachvollziehbar. Betroffen sind diverse, nicht angezeigte Vorschaubilder, sowie einige Java-Scripte.

Erstaunlicherweise ist die mobile Vorschaufunktion dem Original nahezu identisch. Am unglücklichsten erscheint in diesem Test die Pre-render Funktion. Google behält sich vor, nach eigenem Ermessen On-Demand oder Pre-render – Instant Preview anzubieten.

Öffentliches Google Formular für Crawl-Antrag:

Crawl Submit

Mitteilung im Google Webmaster Centrale Blog:

Submit URLs to Google with Fetch as Googlebot

Comments

2 responses to “Google erlaubt die Anmeldung von maximal 50 URL pro Woche”

Ich sehe schon schon Webmaster, die Ihre Information als extrem wichtig sehen und den halben Arbeitstag (etwas übertrieben) auf Crawl Submit klicken und hoffen dann auf Platz 1 zu kommen…

By the way: irgendwo konnt man vor Jahren eine sitemap anmelden und das Ergebnis war bisher immer Phantastisch, von dem Abruf der aktuellen Informationen gesehen.

Also ich habe das auch vor Jahren das letzte mal aktiv gemacht und hatte seitdem auch keine Probleme schnell in den Index zu kommen. Ein paar Backlinks, eine gute URL-Struktur und eine Sitemap sollten genügen um schnell indexiert zu werden.